21. století bylo svědkem toho, že umělá inteligence (AI) provádí úkoly, jako je ruční porážka lidí v šachu nebo rychlá výuka cizích jazyků.

Pokročilejším úkolem pro počítač by bylo předpovídání pravděpodobnosti pachatele spáchání dalšího trestného činu. To je úkol pro systém AI nazvaný COMPAS (Correctional Offender Management Profiling for Alternative Sanctions). Ukázalo se však, že tento nástroj není lepší než průměrný chlap a může být také rasistický. To je přesně to, co výzkumný tým objevil po rozsáhlém studiu systému AI, který je široce používán soudními institucemi.

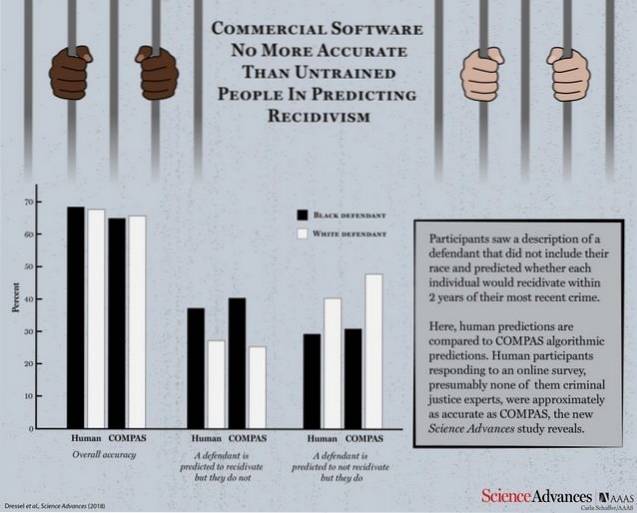

Podle výzkumného dokumentu publikovaného Science Advances byl COMPAS postaven proti skupině lidských účastníků, aby otestovali jeho účinnost a zkontrolovali, jak dobře se daří proti logickým předpovědím normální osoby. Stroji a lidským účastníkům bylo poskytnuto 1 000 popisů testů obsahujících věk, předchozí trestné činy, pohlaví atd. Pachatelů, u nichž bylo možné předvídat pravděpodobnost opakovaných trestných činů.

Se značně menším množstvím informací než COMPAS (pouze 7 funkcí ve srovnání s 137 COMPAS) je malý dav neexistujících odborníků při předpovídání recidivy stejně přesný jako COMPAS.

COMPAS dosáhl celkové přesnosti 65,4% v predikci recidivy (tendence odsouzeného zločince k přestupku), což je méně než přesnost kolektivní predikce lidských účastníků na 67%.

Teď si udělejte chvilku a přemýšlejte ve své mysli, že systém AI, který není o nic lepší než průměrný člověk, byl použit soudy k předpovědi recidivy.

Komerční software, který se široce používá k předvídání recidivy, není o nic přesnější a spravedlivější než předpovědi lidí s malou až žádnou odborností v oblasti trestního soudnictví, kteří odpověděli na online průzkum.

Ještě horší je skutečnost, že bylo zjištěno, že systém je stejně citlivý na rasové předsudky jako jeho lidské protějšky, když byli požádáni, aby předpověděli pravděpodobnost recidivy z popisů, které obsahovaly také rasové informace pachatelů. Neměli byste být příliš překvapeni, protože je známo, že AI přebírá vzorce, které ji její lidští učitelé naprogramují tak, aby se učili.

Ačkoli obě strany výrazně nedosahují přijatelného skóre přesnosti, použití nástroje AI, který není o nic lepší než průměrný člověk, vyvolává mnoho otázek.

Gadgetshowto

Gadgetshowto

![Interaktivní online křížovka o Tech-Biz Trivia [2]](https://gadgetshowto.com/storage/img/images/interactive-online-crossword-on-tech-biz-trivia-[2].jpg)