Naše zkušenosti z první ruky s technologií rozpoznávání obrazu AI, Google Lens, ukázaly, že strojové učení urazilo opravdu dlouhou cestu. Ale tato technologie není zdaleka dokonalá a není tak chytrá, jak jsme doufali, hlavně proto, že tempo, kterým cvičíme počítače k identifikaci modelů, je pomalé. Některé umělé inteligence navíc vyžadují pokročilé výpočty pro neurální síť a naučit stroj určitě není nejjednodušší úkol.

S ohledem na to si skupina výzkumníků Google vzala na sebe vyzkoušet systémy rozpoznávání obrazu AI a zjistit, zda je lze oklamat nebo ne.

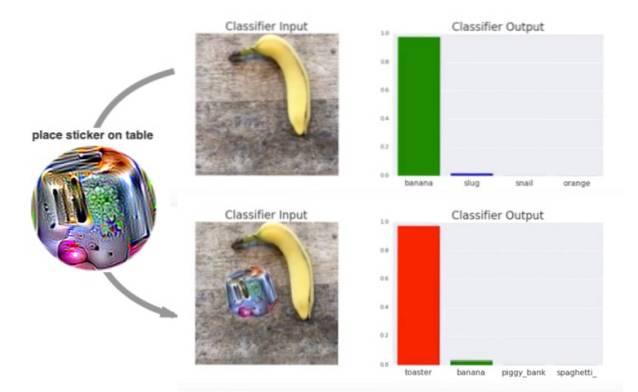

Zdá se, že od té doby se stali vítěznými Systém AI nerozpoznal objekt (zde banán) na ukázkových obrázcích, a to díky speciálně vytištěné psychedelické nálepce.

Vytvoření těchto psychedelické nálepky, které mohou duplikovat systémy rozpoznávání obrázků, jak je popsáno ve výzkumné práci s názvem Adversarial Patch, který byl právě představen na 31. konferenci o systémech zpracování neurálních informací v prosinci 2017. Příspěvek vysvětluje, že vědci vyškolili systém protivníka (oponenta), aby vytvořil malé psychedelické kruhy podobné náhodným tvarům, barvám a velikostem, aby oklamal rozpoznávání obrazu Systém.

Zatímco nejběžnější metodou, jak oklamat systémy rozpoznávání obrazu AI, je změnit obrázek připojením grafiky, vědci ve společnosti Google se rozhodli oklamat systém psychedelickými vzory.

Jak je vidět v níže uvedeném videu, systém dokáže rozpoznat banán a do určité míry i toustovač, když vedle banán umístíte normální obrázek. Ale výsledky jsou méně jasné, když je vedle banánu umístěn psychedelický vír:

Tým také zjistil, že a opravený design vypadá odděleně od předmětu a není ovlivněn faktory jako jsou světelné podmínky, úhly kamery, objekty v pohledu klasifikátoru a samotný klasifikátor.

Vědci dále vysvětlují fungování psychedelických návrhů:

Tento útok generuje opravu nezávislou na obrazu, která je mimořádně důležitá pro neurální síť. Tuto opravu lze poté umístit kamkoli do zorného pole klasifikátoru a způsobí, že klasifikátor vydá cílenou třídu.

I když to na první pohled vypadá, že rozpoznávání obrazu AI je oklamáno, tento experiment bude skutečně použit k odstranění nesrovnalostí v systému. Ti, kdo pracují v této oblasti, se nyní musí přizpůsobit hlučným datům, která mohou být zahrnuta do snímků subjektu. Toto zjištění by mohlo dát systémům poháněným strojovým učením šanci zlepšit se proti podobnému podvodu v budoucnu.

Gadgetshowto

Gadgetshowto

![Historie navigace Google od roku 1998 do roku 2011 [PICS]](https://gadgetshowto.com/storage/img/images/googles-navigation-history-from-1998-2011-[pics]_5.png)